ChatGPT泄露隐私?AI聊天的安全性到底如何?

技术相关

技术相关  好资源AI

好资源AI  发布时间:2025-05-05

发布时间:2025-05-05  浏览: 次

浏览: 次 随着人工智能技术的迅猛发展,越来越多的人开始体验基于聊天机器人的服务,尤其是一些智能对话工具。随着这一技术的普及,隐私泄露的疑虑也随之而来。你是否曾担心过,自己在和AI聊天时,是否会不小心泄露了隐私?ChatGPT泄露隐私?这个话题,已经引起了不少人的关注。特别是当我们每次与智能助手对话时,是否应该对我们输入的每个字词都保持警惕?面对这种潜在风险,咱们如何才能安心使用这些AI工具呢?这些问题不仅关乎个人隐私的保护,更涉及到我们日常生活中的信任与安全。今天我们就来深入一下AI聊天的安全性到底如何,能不能放心使用。

隐私泄露的隐患:数据究竟会去哪儿?

许多人担心的第一个问题是,我们与AI的对话数据是否会被泄露?这是因为,很多AI工具都依赖大量的用户输入来提升服务质量。每次和AI的交流,都有可能被存储、分析,甚至在某些情况下被第三方使用。这些信息究竟有多安全?能否防止外部泄露或滥用?

例如,在一些平台上,AI聊天助手会根据用户的提问内容来优化对话效果,甚至根据对话内容为用户提供相关的产品推荐。很多时候,这意味着用户的个人兴趣、购物习惯、工作需求等都可能被记录下来。而这些数据,一旦未经妥善保护,确实有泄露的风险。对于不懂技术的普通用户来说,这种隐患常常令人感到不安。

针对这种问题,很多智能平台采取了加强隐私保护的措施。比如,采用加密技术来确保用户对话数据在传输过程中的安全性,同时一些平台还会在数据存储时进行匿名化处理,从而降低泄露的风险。用户也可以在某些平台上管理数据的访问权限,比如设置删除历史记录或关闭数据收集选项,这样可以更好地保护隐私。

如何保障我们的数据安全?选择合适的工具很重要

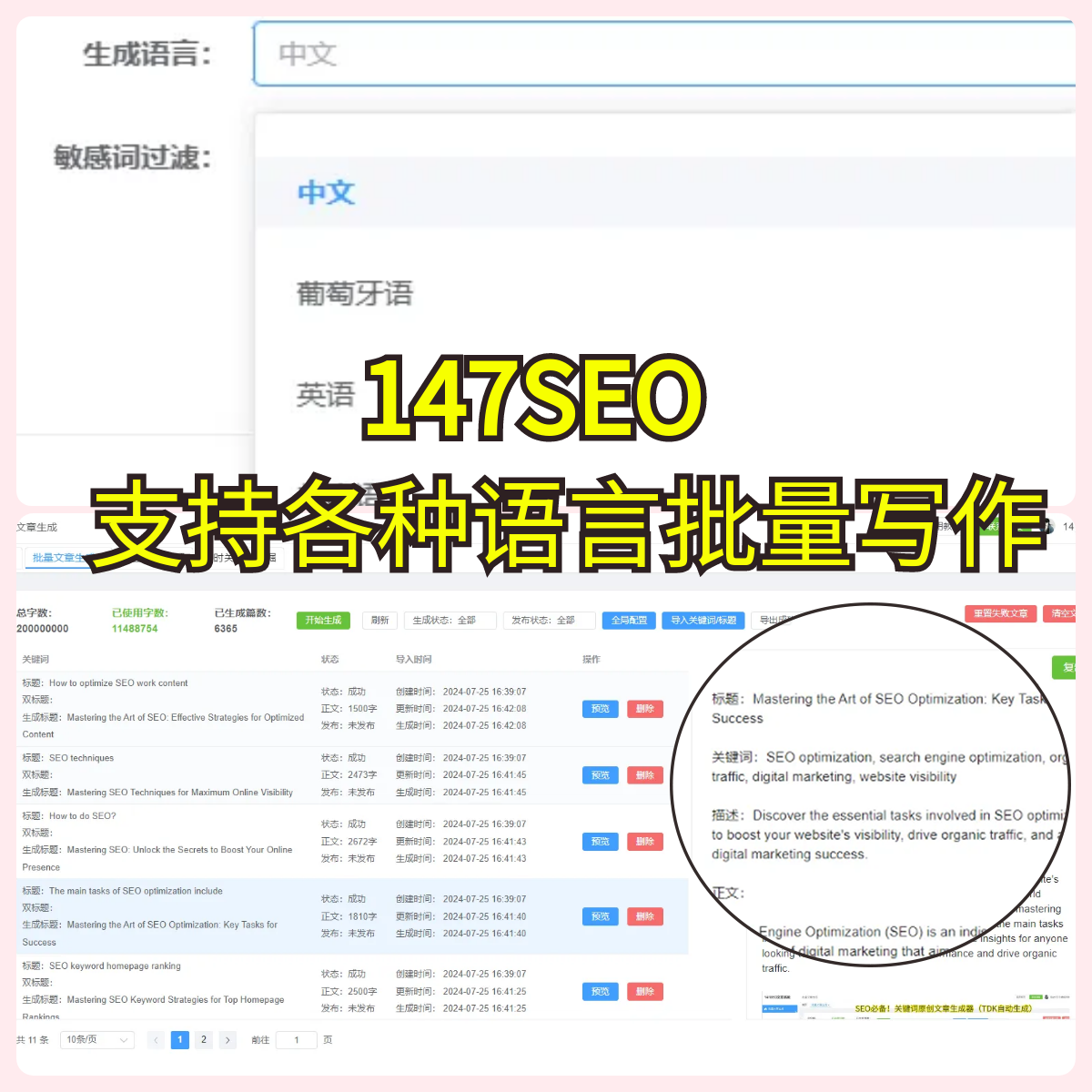

数据安全的保障并不是一蹴而就的,需要选择一些更加重视隐私保护的AI工具。例如,某些平台具备实时关键词挖掘功能,它能够通过智能算法识别并过滤掉一些可能存在的安全隐患内容,防止敏感信息的泄露。通过这种技术手段,用户的隐私数据就能够在生成内容时得到更好的保护。

批量发布等功能在提升工作效率的也能够帮助用户减少个人信息暴露的机会。通过这些工具,内容的传播变得更加精准,且可以快速达成目标,而不需要频繁向平台提供个人数据。

我们能否完全信任AI?如何在风险中找到平衡?

另一个常见的疑虑是,是否应该完全信任AI工具处理我们的信息?事实上,任何技术都有其局限性,AI也不例外。它虽然可以提供便捷的服务,但也存在一定的风险。例如,算法错误可能导致信息处理不当,或者某些平台的安全措施不到位,使得用户的私人信息容易遭到外部攻击。

为了有效规避这些问题,选择一个有良好口碑和安全保障的AI平台至关重要。像西瓜AI这样的平台,通过加密技术和多重身份认证来确保用户信息的安全性,降低潜在的安全风险。平台方还会不断更新和完善安全策略,以确保系统能够应对日益复杂的安全挑战。

通过这种方式,用户在享受AI带来的便捷时,也能够最大程度地减少隐私泄露的风险。

隐私与便捷之间的取舍:能否平衡?

很多人在使用AI聊天时,最看重的其实是便捷性。但便捷性往往伴随着信息的暴露。我们是否能在享受便利的也保证隐私安全呢?

实际上,答案是肯定的。随着技术的进步,越来越多的AI平台开始注重隐私保护与便捷性之间的平衡。比如,某些平台采用了智能过滤系统,既能够精准分析用户输入,提供个性化服务,又能确保个人数据不会被滥用或泄露。这些平台通过加强技术监控,设立严格的权限控制,确保数据不会随意外泄。

结语:隐私保护,人人有责

尽管AI聊天工具提供了许多便捷的功能,但隐私保护始终是我们在使用过程中必须重点关注的问题。正如古人所说:“人无远虑,必有近忧。”面对日益复杂的网络安全形势,我们不能忽视隐私的保护,必须在使用AI服务时时刻保持警惕,选择那些可靠的、有保障的平台。

在享受科技带来的便捷时,我们每个人也应该时刻关注自己的信息安全,做到有选择、有意识地使用AI工具。这样,我们不仅能享受技术带来的便利,更能保障个人隐私,放心地生活在这个数字化的世界中。

相关问答推荐:

问:如何避免在使用AI聊天时泄露隐私? 答:选择具备加密保护和数据匿名化功能的平台,同时定期检查和删除聊天记录,避免过度分享个人信息。

问:AI工具如何保证用户数据的安全性? 答:大多数AI平台会采用加密技术、防火墙等多重安全措施,并允许用户控制数据访问权限,从而确保用户数据的安全性。