AI伦理与ChatGPT,建立信任的必要性

行业资讯

行业资讯  好资源AI写作

好资源AI写作  发布时间:2025-05-11

发布时间:2025-05-11  浏览: 次

浏览: 次 AI伦理这个话题吧,近些年真的是越说越重要,不能不提的。其实,随着人工智能技术不断进步,越来越多的AI应用出现在我们生活的方方面面,比如咱们用的这ChatGPT。你说,AI的进步固然让我们生活变得更加便捷,但与此大家对AI的伦理问题也越来越关注,哎,真的是不容忽视的。就拿这个ChatGPT来说,我觉得(其实这只是我的个人看法),它在为人们提供各种服务的如何保证公平、透明,甚至如何避免对用户隐私的侵犯,都是需要我们特别关注的地方。

说起这些,我感觉,大家是不是都有点担心AI是不是会在某些情况下做出不合适的决策呢?其实,某种程度上,AI做决策的时候是有一定规则的,像ChatGPT就受限于设定的框架,这种设定就是为了避免它做出让人不舒服的反应。不过,问题来了,如何才能让它的“思考”过程更加透明,如何才能保证这些框架真的公正,真的是需要长时间的努力和大量的实践数据支持的。

我个人认为啊,信任的建立其实是非常关键的。就像是人与人之间的关系,AI与人之间的关系,某种程度上也需要建立信任。如果我们使用AI,尤其是像ChatGPT这样的语言模型,如果不能相信它的输出结果,不能确信它不会误导我们,那大家肯定会觉得不安。信任的建立其实就意味着,AI的所有行为必须有足够的透明度,不能让用户感到它在“做假”或者“隐瞒”某些信息。这个信任一旦建立了,人们就能更愿意去使用这些AI技术,也更能看到它带来的价值。

但不得不说,AI伦理的问题也不仅仅局限于模型本身。其实,更多的可能是我们使用AI的人应该怎么正确使用这些工具,比如不利用AI进行恶意的行为。你看,像是内容创作领域,咱们经常会看到有些不法分子利用AI生成一些虚假信息,甚至伪造新闻,这个问题真的是需要整个社会一起重视的。一个AI系统再怎么先进,它也是基于人类输入的数据和设定的算法,能不能规范这些行为,也是让AI健康发展的一个关键。

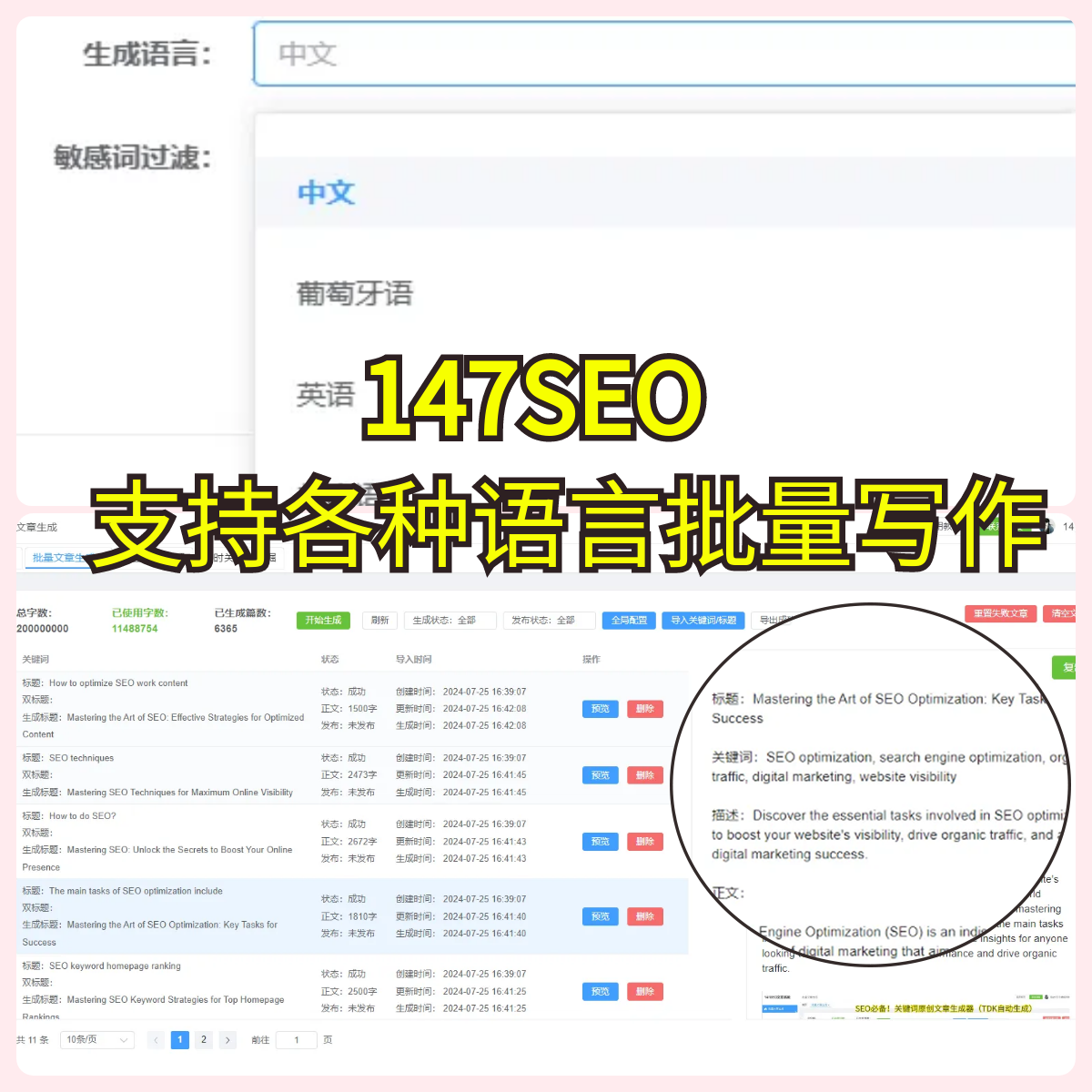

其实,解决这些问题,需要我们社会上的各个层面合作。比如一些科技公司,像好资源AI,他们在做一些AI道德框架的构建,试图通过技术手段来提升AI系统的可信度和安全性。当然了,技术永远是一个方面,人的因素更重要,大家如何理性看待AI、如何避免滥用AI,这些也是需要长时间的教育和引导的。

总的来说吧,我认为建立AI与人之间的信任,既是一项技术任务,也是社会任务。大家都必须共同努力,才能让AI技术更加负责任地为人类社会服务。